学数据分析需要学的知识详解(一)

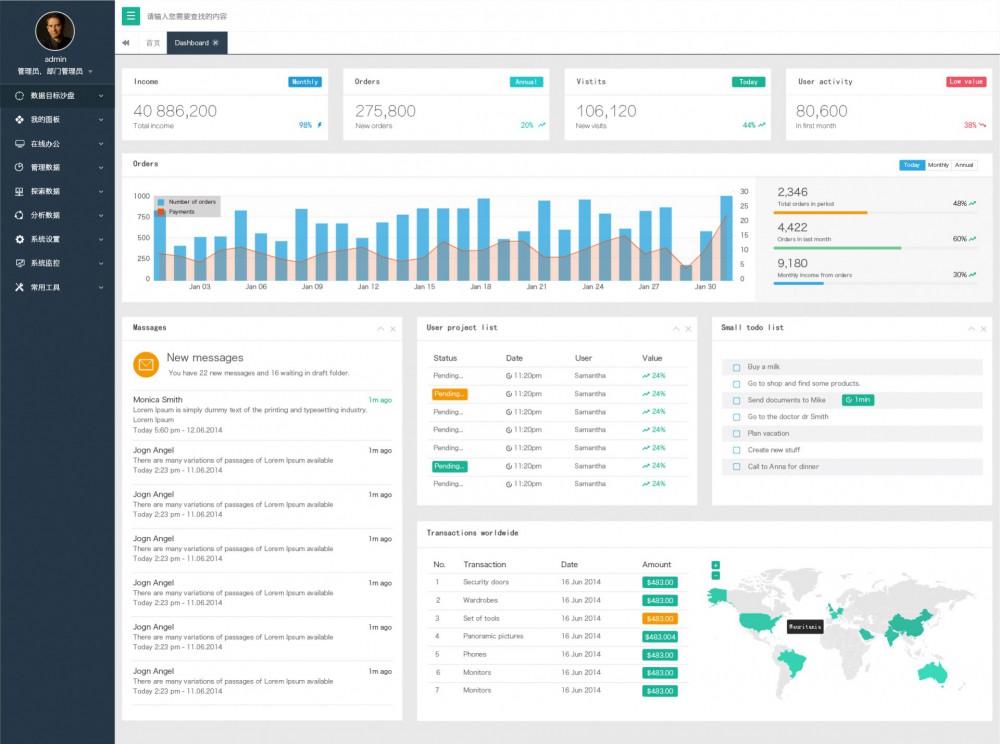

在学习某种技能的时候,我们首先需要知道自己的目的是什么,学了这个技能能够解决什么问题,想必大家在学习技能的时候已经有了自己的想法。就比如说现在很多人想学数据分析知识。学数据分析知识需要制订一个目标,我们在学习之前首先要了解这方面的知识的架构,只有明确了知识的体系,我们才能够有目的有计划地学习数据分析。那么数据分析需要学习什么知识呢?下面就由小编为大家一一道来。在学数据分析之前,我们首先要明确知识架构,我们可以去网站上搜索数据分析师需要掌握的技能是什么,然后我们对数据分析师所需要的技能进行针对性的学习,这样总比盲目的学习要好的多。一般来说,数据分析师需要的技能就是这些:需要掌握SQL数据库的基本操作

滇公网安备 53011202001166号

滇公网安备 53011202001166号 15808795836

15808795836